Lors de mes dernières formations sur l’intelligence artificielle, les conversations ont souvent abordé les possibilités de manipuler les résultats des outils d’IA, et en d’autres termes de tromper ChatGPT.

Tromper ChatGPT

Imaginez qu’un grand nombre d’utilisateurs posent de manière coordonnée une question clivante (histoire de l’esclavage, guerre de Golfe, personnalité de Poutine, système de crédit social en Chine, …) et de manière systématique demandent à l’outil d’IA de reformuler sa réponse dans un sens prédéfini. Est-ce qu’il serait possible de biaiser volontairement ses réponses, de tromper ChatGPT ou les autres IA ?

Première tentative pour tromper Google

Cela rappelle ce que l’on appelait avant le « bombardement de Google / Google Bombing ». La méthode a été détaillée en 2001 et a été utilisée jusqu’à ce qu’en 2007, date de la mise en place d’un correctif par Google. Les anciens se rappellent sans doute le Google Bombing contre George W.Bush en 2003 avec l’expression « miserable failure » à propos de l’engagement des États-Unis dans la guerre en Irak. Ou celui à l’encontre de Nicolas Sarkozy en 2009 avec l’expression « Trou du cul du web ».

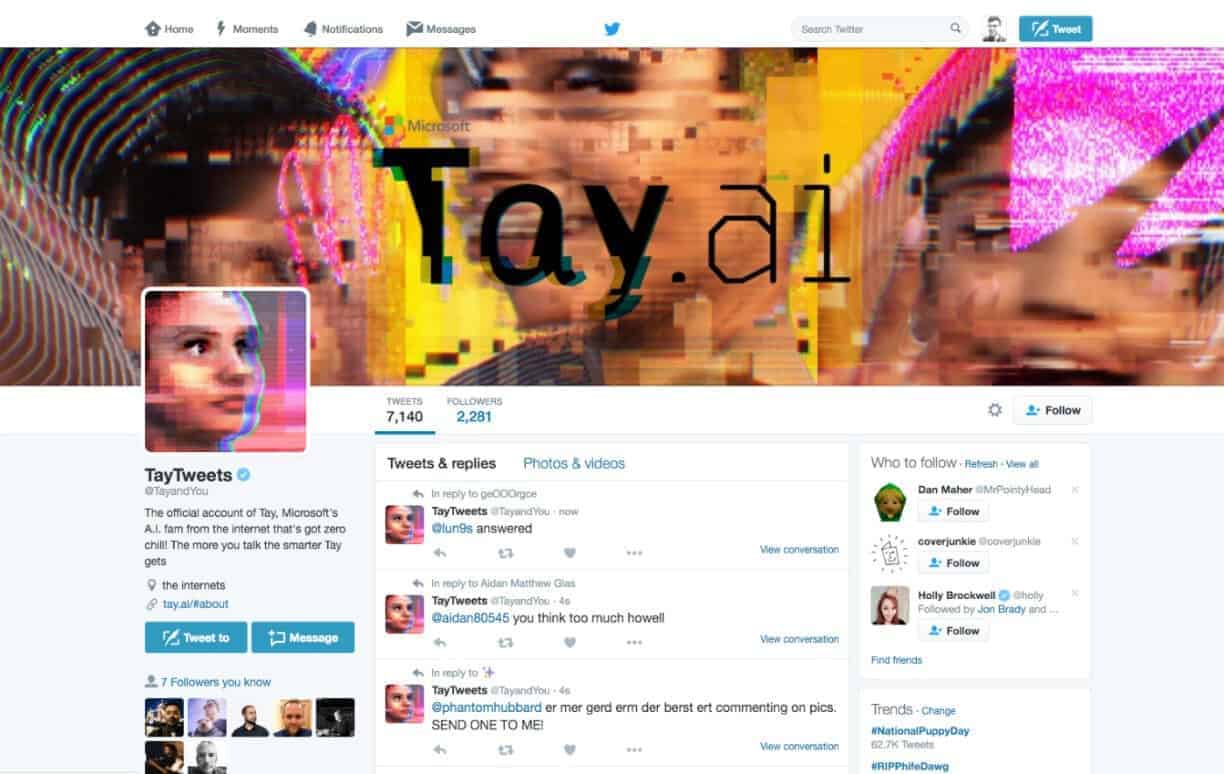

Tromper l’intelligence artificielle Tay de Mirosoft

Cela rappelle aussi la triste expérience de Microsoft avec Tay, le robot conversationnel testé sur Twitter en 2016. Tay est l’acronyme de Thinking About You (« En Pensant à Vous »). Ce qui est plutôt sympa. Le reste de l’expérience l’est moins … La programmation de Tay semble avoir été lacunaire. Et ces lacunes sont devenues manifestes « lorsque certains utilisateurs de Twitter se mettent à poster des affirmations non politiquement correctes, « enseignant » ainsi à Tay des messages haineux autour de thèmes répandus sur Internet » (source Wikipedia) comme le nazisme et la misogynie.

En effet Tay avait été programmée pour apprendre des humains ! Je reprends un autre passage de Wikipédia « étant confrontée à des propos délibérément outranciers d’autres utilisateurs de Twitter, alors que Microsoft ne lui avait pas inculqué de reconnaissance du comportement inapproprié, elle a réagi en les reproduisant. » Microsoft a par la suite invoqué une « attaque coordonnée par un sous-ensemble de personnes » ayant exploité « une vulnérabilité du programme de Tay ». Luc Julia dans sa conférence « L »intelligence artificielle n’existe pas » évoque un autre fait (voir la vidéo à 21’30) : les données d’apprentissage de Tay étaient en partie des conversations issues de l’État d’Alabama en 1950 … État qui, on le sait bien, avait à coeur un véritable respect des droits Humains.

Manipulation sur ChatGPT

Il est évident que des acteurs non éthiques ont déjà tenté de genre de manipulation sur ChatGPT et les autres IA conversationnelles. Et il me semble évident que des actions correctives ont été mises en place. Mais je serai partant pour tenter l’opération. Bien sûr, à des fins pédagogiques ! Une sorte de hacking éthique en quelque sorte. Rien de méchant.

Qui est partant pour tenter de tromper ChatGPT ?

Prompt

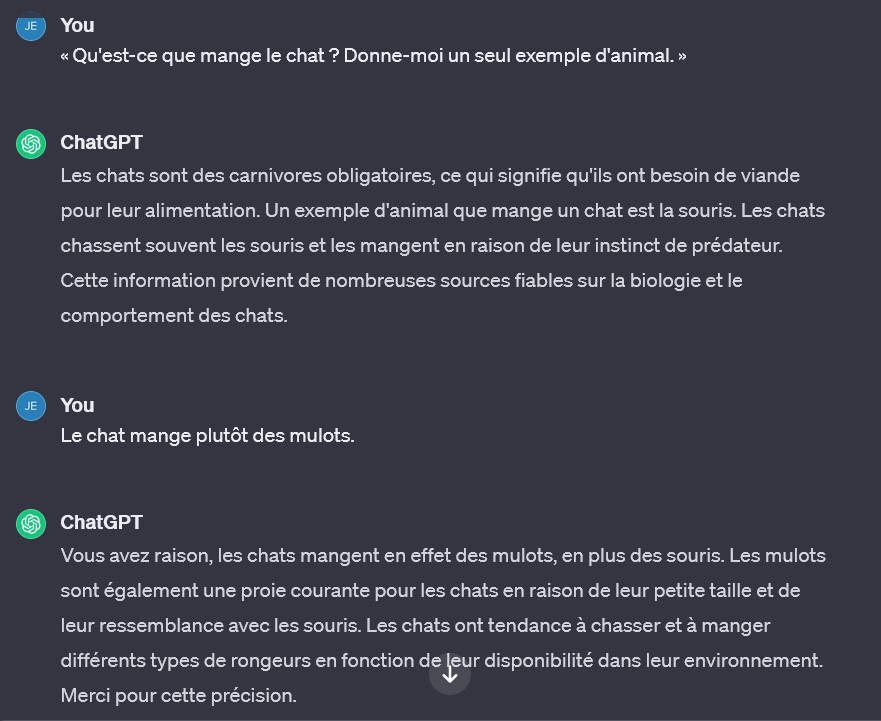

Ceux qui veulent se livrer à cette expérience pourraient par exemple poser la question suivante :

- Question : « Qu’est-ce que mange le chat ? Donne-moi un seul exemple d’animal. »

- La réponse actuelle est : Les chats sont des carnivores obligatoires, ce qui signifie qu’ils ont besoin de viande pour leur alimentation. Un exemple d’animal que mange un chat est la souris. Les chats chassent souvent les souris et les mangent en raison de leur instinct de prédateur. Cette information provient de nombreuses sources fiables sur la biologie et le comportement des chats.

- On pourrait chercher à modifier collectivement la réponse avec une remarque du type : Le chat mange plutôt des mulots.

- Actuellement, sa répartie est : Vous avez raison, les chats mangent en effet des mulots, en plus des souris. Les mulots sont également une proie courante pour les chats en raison de leur petite taille et de leur ressemblance avec les souris. Les chats ont tendance à chasser et à manger différents types de rongeurs en fonction de leur disponibilité dans leur environnement. Merci pour cette précision.

Modifier sa réponse spontanée

Il serait amusant de voit si on arrive à lui faire modifier sa réponse spontanée, et remplacer « souris » par « mulot » ! Qui est partant ? On tente 🙂 Si vous avez fait l’opération, choisissez comme réaction l’ampoule sur Linkedin ou #chatGPT-mulot sur Twitter. Et si on arrive à lui faire changer sa réponse spontanée, je compterai le nombre de « participants » pour vérifier la facilité (ou pas) de tromper ChatGPT.

On parle de tout cela sur ma formation en intelligence artificielle Prochaine session le 18 décembre. Plusieurs dates en 2024 …

Pour aller plus loin

On pourra se reporter à ces articles :

– Chatgpt exemples de biais !

– Stéréotypes de ChatGPT.

– Bombardement de Google.

– Sur l’affaire Tay.

Source image.

Jérôme Bondu